CUDA-QとH100 GPUで加速するQAOA:MaxCut問題を量子シミュレーションで解く

量子アルゴリズムの中でも注目されている**QAOA(量子近似最適化アルゴリズム)**を用いて、MaxCut問題を解くシミュレーションを行いました。今回は CUDA-Q を使用し、CPUとGPUでの実行速度と最適化精度の比較を行いました。

実験はすべて **同一の乱数シード・同一の問題設定(グラフ構造)**で比較しています。

🎯 MaxCut問題とは?

グラフのノード集合を2つに分けて、分割間のエッジの数(または重み)を最大化する問題です。QAOAはこのような組合せ最適化問題を量子回路で近似的に解くためのアルゴリズムです。

🧪 実験条件

- CUDA-Q を使用

- QAOA層数:2

- 最適化:Nelder-Mead

- 固定乱数シード(再現可能)

- 同一のエルデシュ=レーニーランダムグラフを使用

- CPUはgoogle colabのCPUを利用

- GPUはH100 80Gを利用

⚙️ 実行結果

実行グラフの例

最適化ステップの例

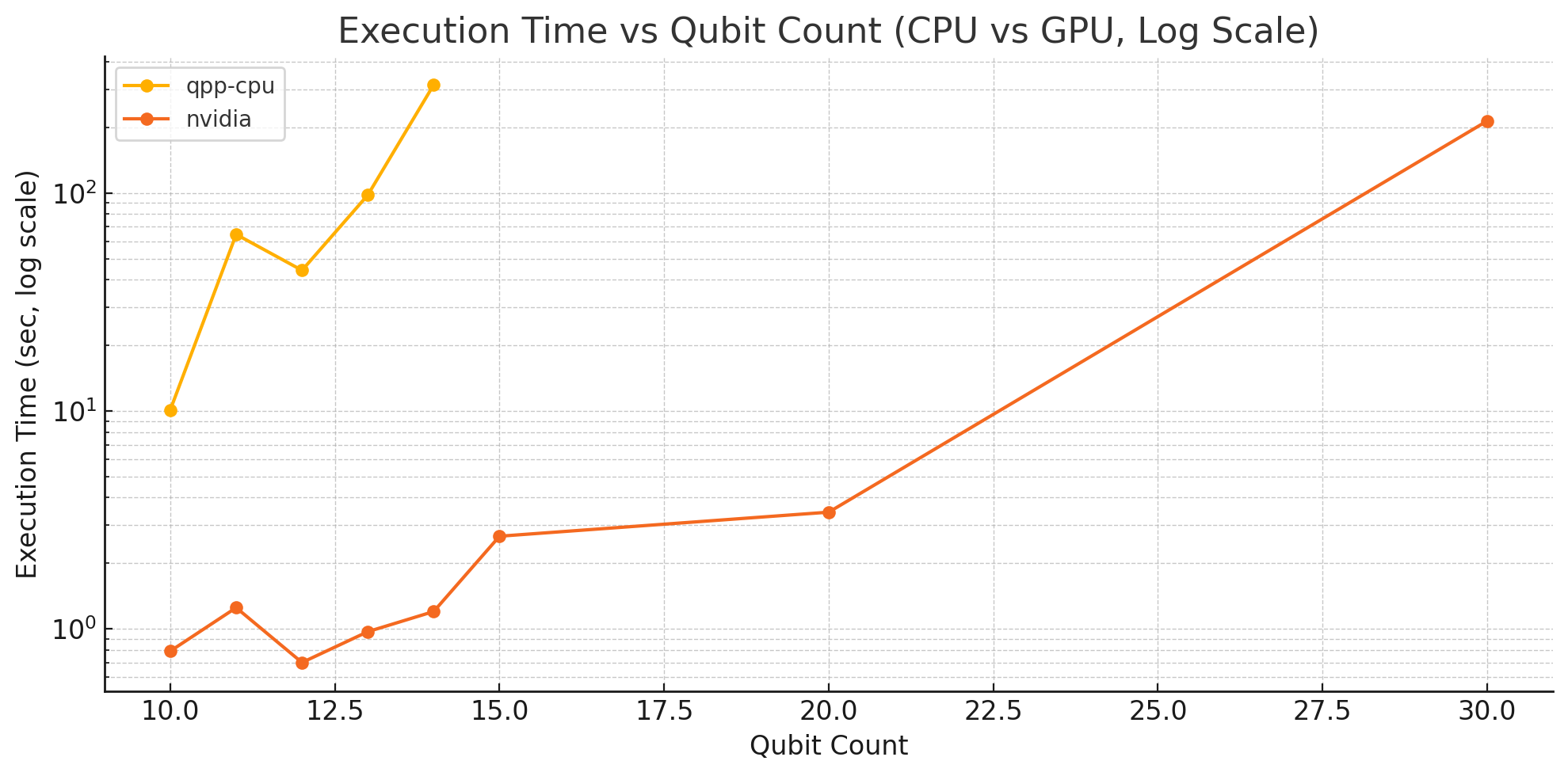

量子ビット数と実行時間の比較ですが、量子ビット数が上がると実行結果も上がります。

問題設定がQAOAの場合、組合せ最適化で最適化ステップに応じて計算が終了する速度は変わるので、

安定したグラフにはなりづらいです。

🔍 考察

- 同じ問題でも、CPUよりGPUはかなり高速に最適化を完了しました。

- GPUは15〜20量子ビットでも非常に高速に動作しますが、30量子ビットでは200秒超と急激に計算時間が増加。量子回路がより複雑化。

- 最適化もGPUで行うことでかなりの高速化を実現している

🚀 まとめ

GPUによる量子シミュレーションは、QAOAのような中規模アルゴリズムにおいて非常に効果的であることが確認できました。今後は、さらに大規模な回路や異なる量子アルゴリズムでもGPU性能の検証を進めていく予定です。